AI 機能(ollama との連携)

Ver 1.0.6 から搭載。

何かと話題の LLM は、どこかでその機能を組み込みたいと思っていたのだが、ウェブサービス系は情報漏洩のリスクがあるので手を出しにくかった。

調べているとローカルで稼働する LLM があるということで、その代表格の ollama をあれこれ触っていた。

まあまあ使えそうだったので、まずは SOA 履歴の文書作成支援機能を ollama に担わせることにした。

実際に使うには、ollama 自体が走っていないといけない。開発当初は OceanMini が走っているローカルマシンにしていたが、流行とはいえ医療者に馴染みがあるとも思えない ollama の準備ができる人はそんなに多くいるとは思えず、某所サーバーに ollama を走らせ OceanMini と通信させることにした。

→某所サーバーのマシンパワーが非力すぎてマトモに使えないため、結局、ローカルマシンの ollama に問い合わせる形式に逆戻りしてます。

この機能を使いたい場合は、

model: pakachan/elyza-llama3-8b:latest

が

http://localhost:11434/v1/chat/completions

で問い合わせできるようにしておいてください。

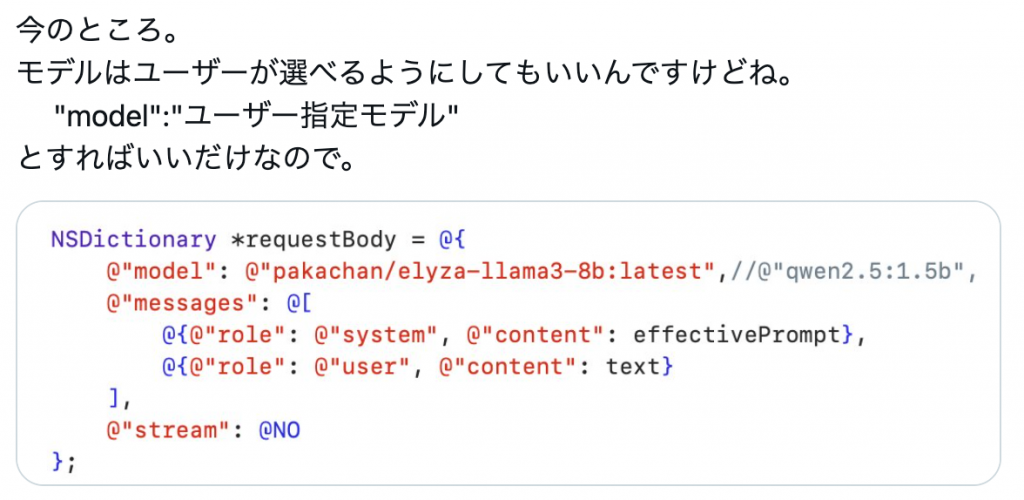

上記モデル以外を使いたい場合はご相談ください。

内部的には、モデルを指定している文字列を使いたいモデルに変更すればいいだけですので、改変は容易です。

上部メニューの「AI」を選ぶと患者選択画面に遷移する。

解析対象の患者さんを選ぶと、これまでに記録された当該患者さんのカルテが一覧で表示される。

上部のボタンを押すと ollama による文書作成支援が始まります。

まず、プロンプト編集エディタがモーダルで立ち上がる。

プロンプトが確定すると

カルテ SOA 欄を時系列で取ってくる

→html タグを削除

→このテキストを編集したプロンプトとともにelyza-llama3-8bに渡す(別スレッド)

→結果を新規カルテに表示(120secでタイムアウト)

というように動く。

個人的には AI 系はまだまだこれからと思っているので、現時点では連携機能はこれくらいでいいのかなと思っています。

参考